![]()

“¿Qué población desea?” “Con Barcelona hay dos horas de demora, cuelgue y le llamaremos”. A sus 93 años, Celina Ribechini no solo recita de memoria las frases que repetía una y otra vez en su trabajo de telefonista hace más de siete décadas, cuando las manos femeninas conectaban cables de las centralitas para establecer las llamadas.

Esta bilbaína también recuerda con exactitud el examen que aprobó en 1942 para conseguir un puesto en la central de Pamplona de la joven Compañía Telefónica Nacional de España (CTNE), fundada en 1924. Además de cumplir los requisitos para presentarse a las oposiciones (ser soltera, tener entre 18 y 27 años, no utilizar gafas, ser capaz de separar los brazos 1,55 metros o mostrar un certificado de buena conducta), realizó una prueba con los auriculares, dos dictados (“uno deprisa y otro despacio”) y respondió a unas “cuantas cuestiones de geografía, un poco de historia y de cultura general”.

“En aquella época no pude estudiar y económicamente mi casa estaba muy mal, había que sacar dinero”, explica Celina a HojaDeRouter.com. Hoy doctora en Historia por la Universidad de Deusto (defendió su tesis después de jubilarse), aquellas pruebas a las que se presentó tras realizar el Servicio Social obligatorio marcarían su futuro y el de muchas otras jóvenes que pasaron a trabajar delante de un panel repleto de clavijas y luces.

Tiempo atrás, en 1928, el año en que Alfonso XIII realizó la primera llamada transoceánica desde el Edificio Telefónica de la Gran Vía madrileña, comenzaban a trabajar en la capital las cuatro protagonistas de la primera serie de Netflix enteramente producida y rodada en España.

‘Las chicas del cable’, cuyos nueve primeros episodios verán la luz este viernes de forma simultánea, refleja el día a día de las mujeres que ponían en contacto a los abonados, manejando los cables con asombrosa rapidez. Un oficio exclusivamente femenino (si bien los primeros operadores eran hombres) que permitió a muchas mujeres incorporarse al mundo laboral, lo que no era lo habitual en la época.

Mujeres, solteras y jóvenes

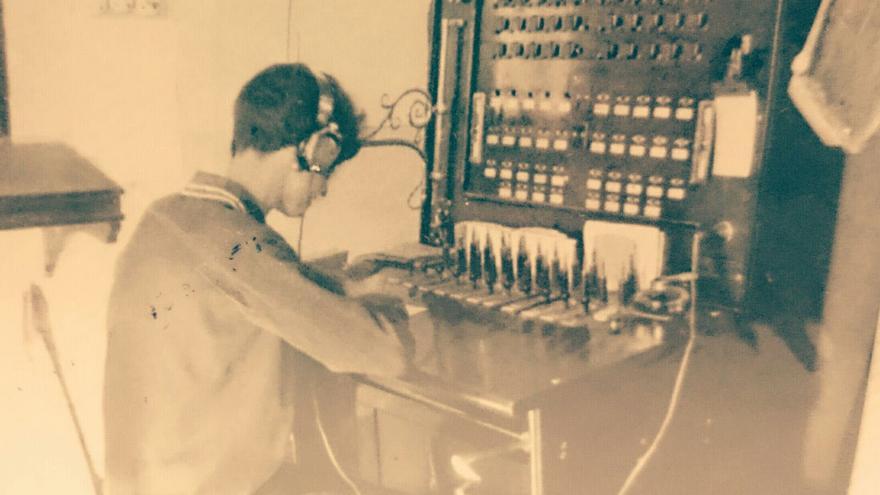

Organizadas por turnos, las operadoras de la central telefónica de Pamplona permitían que los abonados se comunicaran las 24 horas del día en cualquier momento del año. La disciplina era casi militar: unos minutos antes de su hora de entrada, se cambiaban para ponerse su uniforme azul. Una sucesión de timbres les avisaba de que debían prepararse y, poco después, entrar en la sala.

En correcta formación y con “la vigilanta al frente” (la encargada de controlar el tráfico), cada operadora se dirigía a su “posición” en el cuadro de conexiones, sustituyendo a la anterior, que también salía en rigurosa fila.

En un primer momento, Celina desempeñaba su labor en una “torrecilla”, una mesa apartada del cuadro de operaciones. Recibía las llamadas, recogía los datos del abonado y los anotaba en un tique para que otra compañera pusiera después la conferencia, un labor que ella también realizó posteriormente. “Cuando tenías que ir al servicio se lo tenías que decir a la vigilanta para que viniera otra. El cuadro no se podía dejar libre”, rememora Celina.

Aunque reconoce que el trabajo “era duro”, le satisfacía realizar un trabajo que le permitía ser independiente en lo económico. “Mi madre murió, mi padre se casó otra vez, sin eso no sé qué hubiera sido de mí. No me tuve que humillar ante nadie. Con lo que he tenido, he salido y he podido llegar a la situación en la que estoy hoy”, aprecia Celina.

Ser soltera le permitió conservar ese trabajo, pues las casadas, en aquellos años, eran obligadas a dejar su puesto de telefonistas (en el Fuero del Trabajo de 1938 ya se hablaba de “liberar a la mujer casada del taller y de la fábrica”). “Mi hermana, que desgraciadamente murió por aquel entonces, tenía novio, se iba a casar y sabía que iba a tener que dejar el trabajo. Podía pedir una excedencia en el caso de que se quedara viuda o el marido enfermara”, recuerda.

Que algunas mujeres se quedaran solas trabajando por la noche también era algo excepcional en la dictadura. Según nos cuenta Celina, muchas aprovechaban la tranquilidad nocturna, frente al ritmo frenético que llevaban durante el día, para llamar a sus novios o charlar con los redactores de periódicos que “terminaban a esas horas y se aburrían”.

También había hueco para el puritanismo en las centralitas. “‘Tilín! ¡Tilín! Campanitas de la Virgen”, anunciaba una operadora desde la central de Logroño a las cinco de la mañana. Tras contactar con todas las centrales de España, convocaba con esa llamada a las telefonistas para que rezaran el rosario poco antes de que los transportistas comenzaran a coger el teléfono al alba.

Las mujeres que desempeñaban el oficio también tenían que pasar los festivos delante de las luces y clavijas. Celina aún recuerda que, en Nochevieja, los mecánicos y ellas lo celebraban juntos “un poco”, minutos antes de la doce. Pasada esa hora, la sala se volvía “un incendio de llamadas”.

Una vida independiente en Madrid

Lola Blasco también tiene el recuerdo de comerse las uvas delante del cuadro de conexión. Esta operadora comenzó a trabajar en Telefónica años después que Celina, ya en los 60, aunque su trabajo era similar. Tras estudiar el bachillerato (un hecho que, según nos cuenta, extrañó al jefe de personal), consiguió un puesto en la central de Alicante con tan solo 18 años.

Tiempo después pidió el traslado para trabajar en Madrid, como ‘Las chicas del cable’ de Netflix. “Yo es que era un poco adelantada a mi tiempo. Me gustaba vivir y me fui a Madrid”, asegura. Más de doscientas telefonistas trabajaban en su misma unidad del Edificio Telefónica, destinada a atender las llamadas de la provincia de Madrid. “Un señor marcaba el 09, ‘póngame con Alcorcón’, y entonces dices: '¿qué número quiere usted de Alcorcón?’”, recuerda Lola.

Tras conectar un extremo del cable a la clavija de la luz que se encendía, la telefonista se comunicaba con el abonado y conectaba el otro extremo con el centro al que deseaba llamar. Mientras los interlocutores conversaban, ellas manejaban una llave que les permitía oír la conversación. “Había que observarlo porque antiguamente se cortaban mucho las comunicaciones”, justifica Lola.

No obstante, durante los seis meses del cursillo de formación que tuvo que pasar para ser operadora, la enseñaron que debía guardar secreto. Tampoco es que tuviera tiempo para fijarse en los detalles. A la telefonista le faltaban manos para atender varias llamadas a la vez, y cuando no daba abasto, las luces comenzaban a parpadear para alertarle de las que tenía pendientes.

A ello se sumaba la presión de las observadoras, un grupo de mujeres que paseaban detrás suya, sin que se percatase, para comprobar si trabajaba y se dirigía correctamente a los abonados. Pese al frenético ritmo de trabajo y al control férreo y constante, Lola no supo de ningún despido.

“En los años que he vivido en Telefónica, nunca, porque aunque no quisieras trabajar, del 'trabajazo' que había tan tremendo tenías que hacerlo [...] Y sin aire acondicionado, cariño. Aquí en Alicante yo he visto cómo se caía la gente en el mes de agosto mareadas”, rememora.

Lola cree que las jornadas duraban siete horas precisamente por la intensidad de la labor (“ocho no había cuerpo humano que lo hiciera, era a tope desde que entrabas sin parar”), aunque eso sí, disponía de dos emergencias para ir al servicio y un descanso de media hora en una sala donde las telefonistas se reunían para tomar un bocadillo o un café.

Pese a la disciplina casi militar, el ambiente de compañerismo ayudaba a que el trabajo en Telefónica se hiciera más llevadero. Las jefas de sala y unidad eran como “madres” para Lola, y las otras telefonistas se convirtieron en sus amigas. “Las compañeras éramos una piña”, recuerda.

Además, los sueldos permitían “vivir bien”, aunque la mano de obra femenina fuera más barata, y en Madrid gozaba de independencia, ya que vivía en un piso compartido con unas amigas. Como no le gustaban los domingos, cambiaba a sus compañeras esas jornadas para tener días libres entre semana y poder pasear más tranquila por las calles de la capital o visitar el Museo del Prado, ya que la pintura es una de sus pasiones. “La experiencia que he tenido en Madrid ha sido maravillosa”, considera.

La tristeza de la última telefonista

Magdalena Martín también ponía en contacto a los abonados, aunque a diferencia de Celina y Lola, no lo hacía en una gran capital, sino desde su propia casa en Polopos, un pueblo de la Alpujarra granadina que contaba con 260 habitantes y tan solo 46 abonados. “Llamaban desde sus casas y en mi casa se encendía una ‘lucecica’ y sonaba un timbre, y entonces yo iba corriendo, le metía la clavija a la luz y decía ‘dígame’”, describe Magdalena, la última telefonista de España.

Los que no disponían de teléfono iban a su casa a solicitar la llamada. Si alguno de ellos era el destinatario, la propia Magdalena se desplazaba al lugar donde estuviera el vecino para decirle un “venga usted a las 4 que le va a llamar su hija”. Un trabajo que le permitía conocer de primera mano las buenas y malas nuevas del pueblo, desde los nacimientos a las muertes, aún sin escuchar las conversaciones: los propios abonados le informaban al charlar con ella. Tanta confianza llegaba a tener con los que visitaban su centralita que acabó sabiendo de memoria los números a los que solían llamar.

El primer centro local se abrió en Ajofrín (Toledo) en 1893, y desde ellos se podía acceder a un centro superior (en el caso de Polopos, Albuñoz) para conectar con cualquier punto del mundo. “Aquí hay muchos extranjeros”, explica Magdalena. “Entonces pedían conferencias a Dinamarca, a Estados Unidos, a Andorra...”

Ella heredó la centralita de su suegro y se volcó en un trabajo que, a diferencia del que realizaba las telefonistas en la capital, no tenía horarios: había que estar pendiente de las llamadas en todo momento. “Las 24 horas, aquí no se podía quitar nadie", recuerda. "Cuando fui a dar a luz tuve que enseñar a una chica para que se quedara con mi suegra, porque era mayor. Si yo iba a misa, mi marido se tenía que quedar en la centralita”.

Pese al crecimiento de las centrales locales (en 1924 había menos de 300; en 1969, más de 10.000), la progresiva automatización hizo que el trabajo de las telefonistas fuera desapareciendo. La última centralita manual fue precisamente la de Magdalena. Las autoridades decidieron celebrar una gran fiesta en Polopos el día de la clausura, el 19 de diciembre de 1988.

Mesas llenas de jamón y vino se llevaron a la plaza, amenizada con música, para los invitados de excepción: José Barrionuevo, el ministro de Transportes, Turismo y Comunicaciones, y Luis Solana, por entonces presidente de Telefónica, que llegaron en helicóptero a la localidad. Los dos se presentaron en casa de Magdalena, que realizó la última conexión para llamar al mismísimo Felipe González, presidente del Gobierno. “Yo estaba muy nerviosa porque mi voz sonó en la plaza”, rememora.

Ella no tuvo ocasión de disfrutar el ambiente festivo de una jornada que se narró en las crónicas de aquel momento y que aún es recordada en Polopos gracias a una placa conmemorativa. “Siempre he atendido el teléfono para luego lo mal que se portaron”, protesta.

Magdalena se quedó en el paro. Al ser una empresa “familiar”, Telefónica se limitó a indemnizarles, pero, según su relato, no le ofrecieron ningún puesto de trabajo. Lo que sí hizo la compañía fue llevarse el cuadro y la silla en la que Magdalena había pasado tantos ratos, incluso el bloc de notas donde apuntaba las llamadas, con el fin de preservar esos objetos que hoy son parte de la historia de las telecomunicaciones.

Tras acabar la fiesta, las autoridades invitaron a comer a su marido, pero no a Lola (“podían haber dicho ‘véngase usted’”), que se quedó en casa sin tener ya abonados a los que poner en contacto. “Me llamaron desde Barcelona y una operadora me dio la enhorabuena porque era la última de España. No se me olvidará nunca”.

Para entonces, Celina y Magdalena llevaban años alejadas del oficio de telefonista. La primera pasó a ser supervisora del Servicio de Abonados, un puesto administrativo que le gustaba menos que el trabajo en el cuadro. “De todos los años que he estado en Telefónica, que han sido 40, los que más me han gustado han sido los que he estado de telefonista”, destaca Celina, una mujer incombustible que, ya nonagenaria, ha publicado el libro ‘Retazos y pinceladas. Historia en Euskalherria’.

Lola, que tiene ahora 68 años, se prejubiló hace una década, tras ser administrativa o asesora comercial, un puesto que la obligó a volver a Alicante. Al igual que la historiadora, recuerda con cariño su etapa como telefonista: “Fueron los mejores años de mi vida. Dentro del trabajo, los mejores. Éramos amigas y compañeras”.

Como amigas y compañeras son las 'chicas del cable' que protagonizan la serie de Netflix, cuatro mujeres que en los felices años 20 lograban incorporarse al mundo laboral desempeñando el extinto y tristemente olvidado oficio de telefonista.

--------------

Las fotografías han sido cedidas por Celina Ribechini (1 y 2), Lola Blasco (3), Francisco Page (4) y Magdalena Martín (5)